Proxmox VE (PVE) 实战指南

Proxmox VE (PVE) 实战指南

💡 编者按:本文采用分卷连载形式,目标是系统覆盖 Proxmox VE 在单机与集群场景中的关键技术与工程实践。

内容包括 KVM/LXC 虚拟化、PCIe 直通、ZFS/Ceph 存储、SR-IOV、SDN 网络与高可用集群。文中会尽量标注前置条件、版本差异和风险边界,便于在 HomeLab 与生产场景按需取用。

📖 卷一:底层架构、硬核硬件选型与系统底层机制

1. 重新认识 Proxmox VE:不止是“虚拟机” 🧠

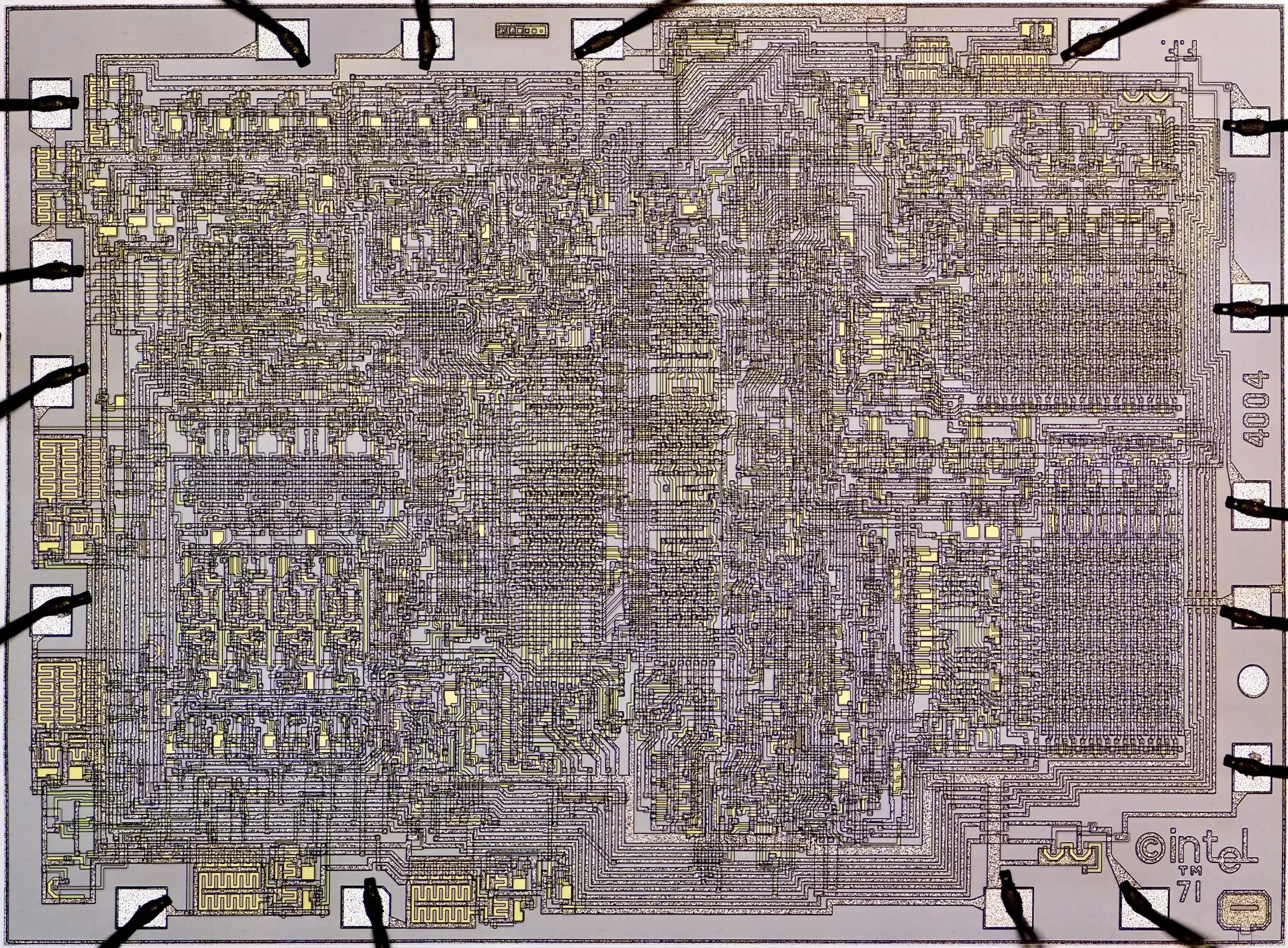

在深入技术细节之前,先纠正一个常见认知偏差:Proxmox VE 不是桌面级虚拟机软件,而是基于 Debian Linux 的服务器虚拟化与集群管理平台。

1.1 KVM (Kernel-based Virtual Machine) 的全虚拟化

PVE 的核心虚拟化引擎是 KVM。KVM 以内核模块的形式工作,宿主机内核负责 CPU 调度、内存管理与设备协同。

- 当你在 PVE 中创建一个虚拟机时,这个虚拟机在宿主机上体现为一个 QEMU/KVM 相关进程(常见为

qemu-system-x86_64)。 - 虚拟机的每一个 vCPU,就是宿主机上的一个线程。

- 这种架构的优势在于:KVM 可以直接利用 Linux 内核极其成熟的任务调度器(CFS)、内存管理机制(KSM,内核同页合并)和硬件驱动库。

1.2 QEMU 的设备模拟

仅仅有 KVM 是不够的,KVM 只负责 CPU 和内存的虚拟化。虚拟机的网卡、显卡、硬盘控制器、USB 接口等外设,是由 QEMU 来模拟的。PVE 使用了经过定制优化的 QEMU。为了突破软件模拟带来的巨大性能损耗,PVE 广泛采用了 VirtIO 半虚拟化框架。通过 VirtIO,虚拟机知道自己是运行在虚拟环境中的,它直接与宿主机进行高速的数据交换,绕过了硬件模拟的开销。

1.3 LXC (Linux Containers) 的轻量级隔离

PVE 的另一大杀器是 LXC。与 Docker 主打“应用容器(Application Container)”不同,LXC 是“系统级容器(System Container)”。

- LXC 并不虚拟化任何硬件,它直接使用宿主机的内核。

- 它通过 Linux 的

Cgroups(控制组,用于限制资源如 CPU/内存)和Namespaces(命名空间,用于隔离进程、网络、文件系统)来实现隔离。 - LXC 启动和资源开销通常明显低于完整虚拟机,但实际数据会随镜像、服务数量、内核特性和宿主机配置变化。

2. 架构师级别的硬件选型指南 🖥️

很多人在组装 PVE 服务器时,仍沿用桌面平台思路(过度关注高频和峰值单核)。在虚拟化场景中,这种策略往往不是最优解。

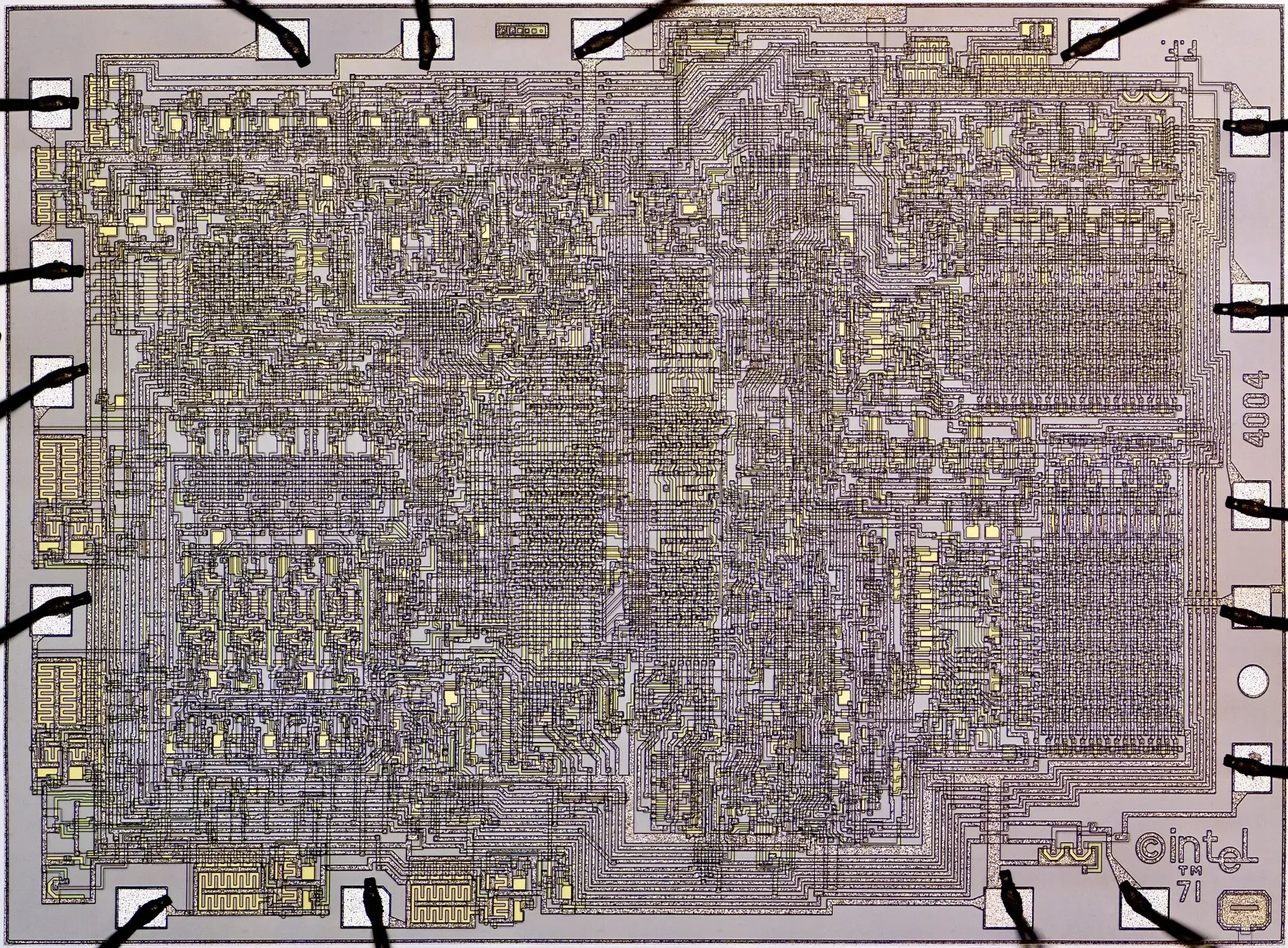

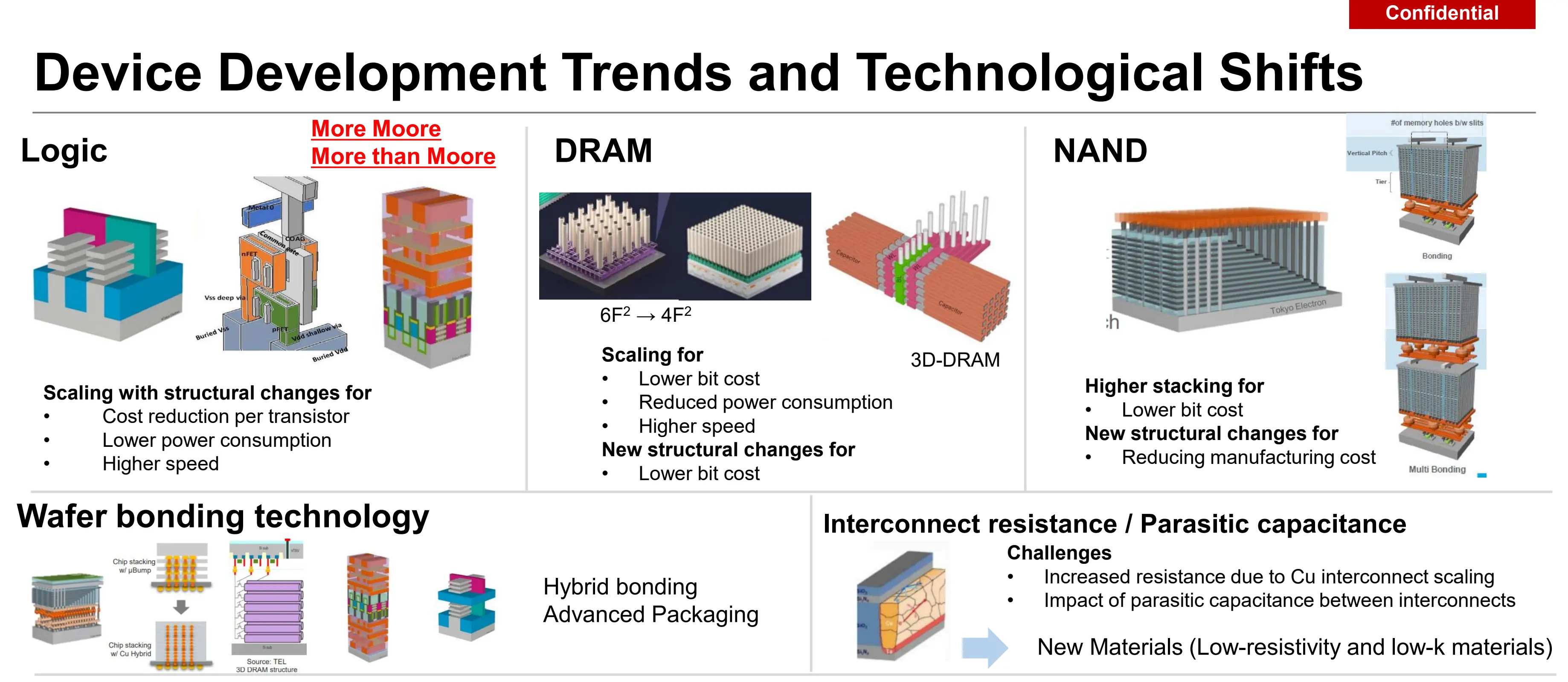

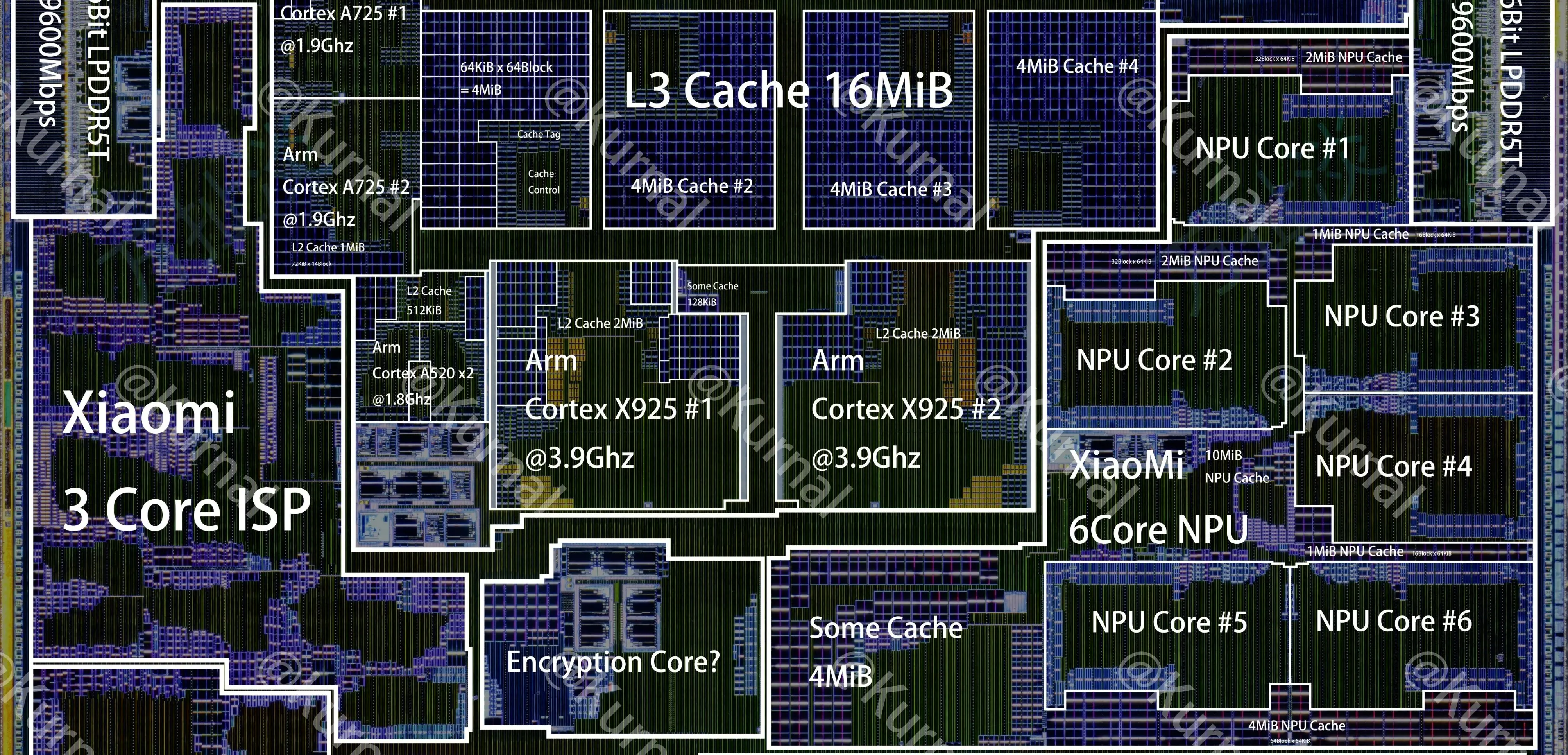

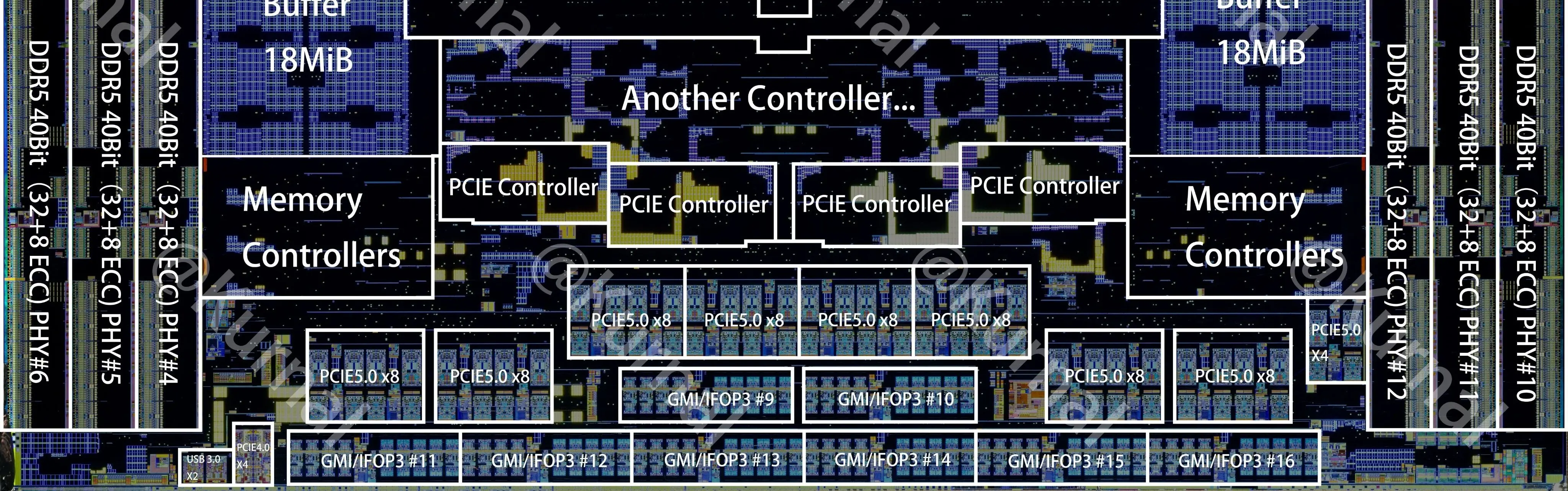

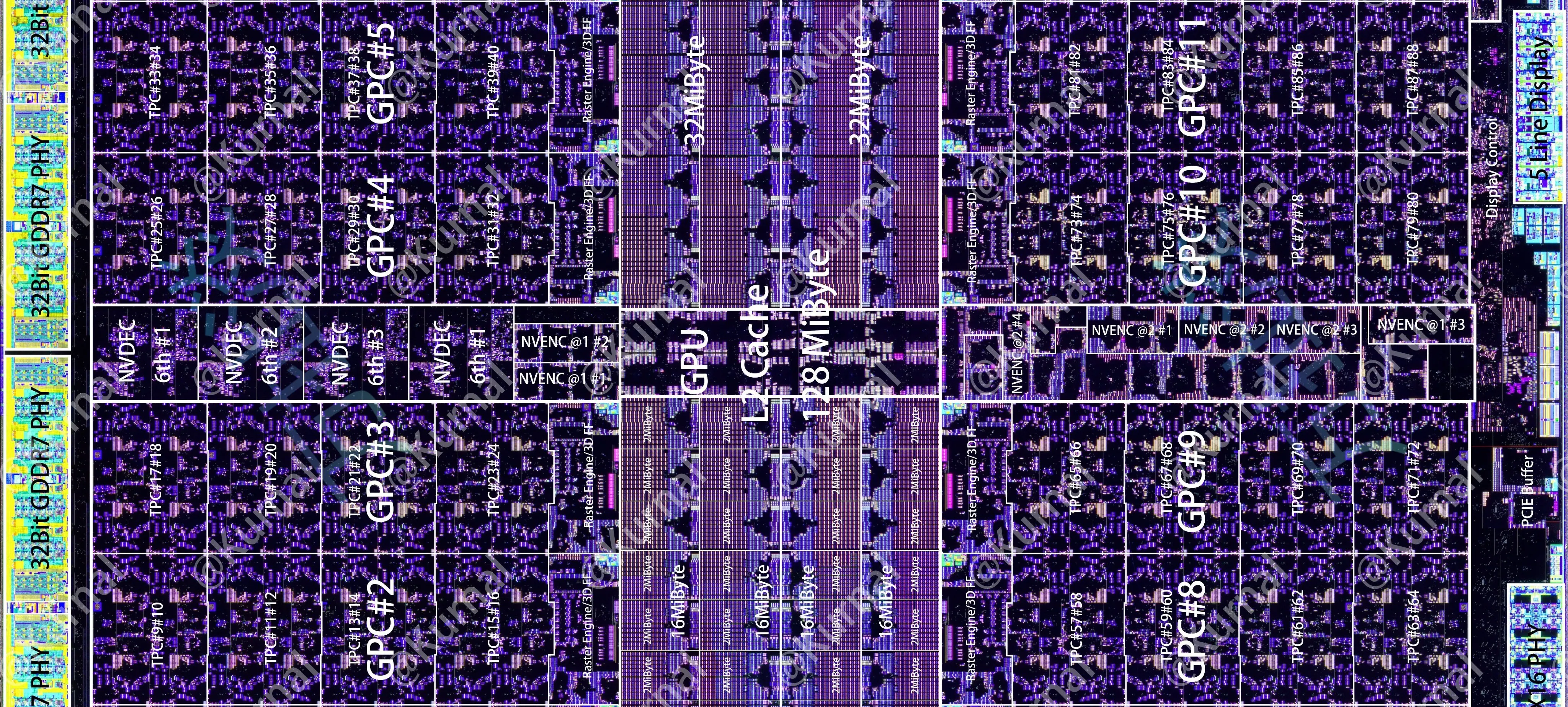

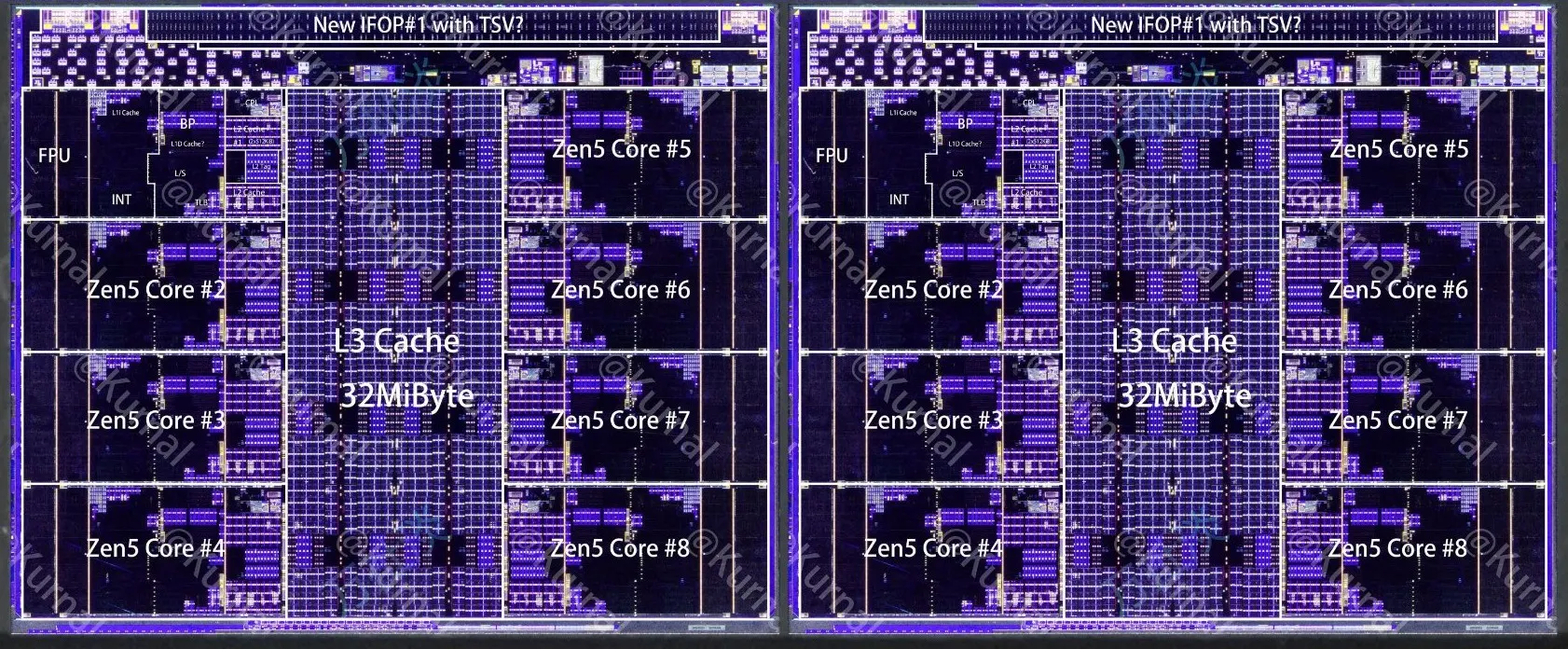

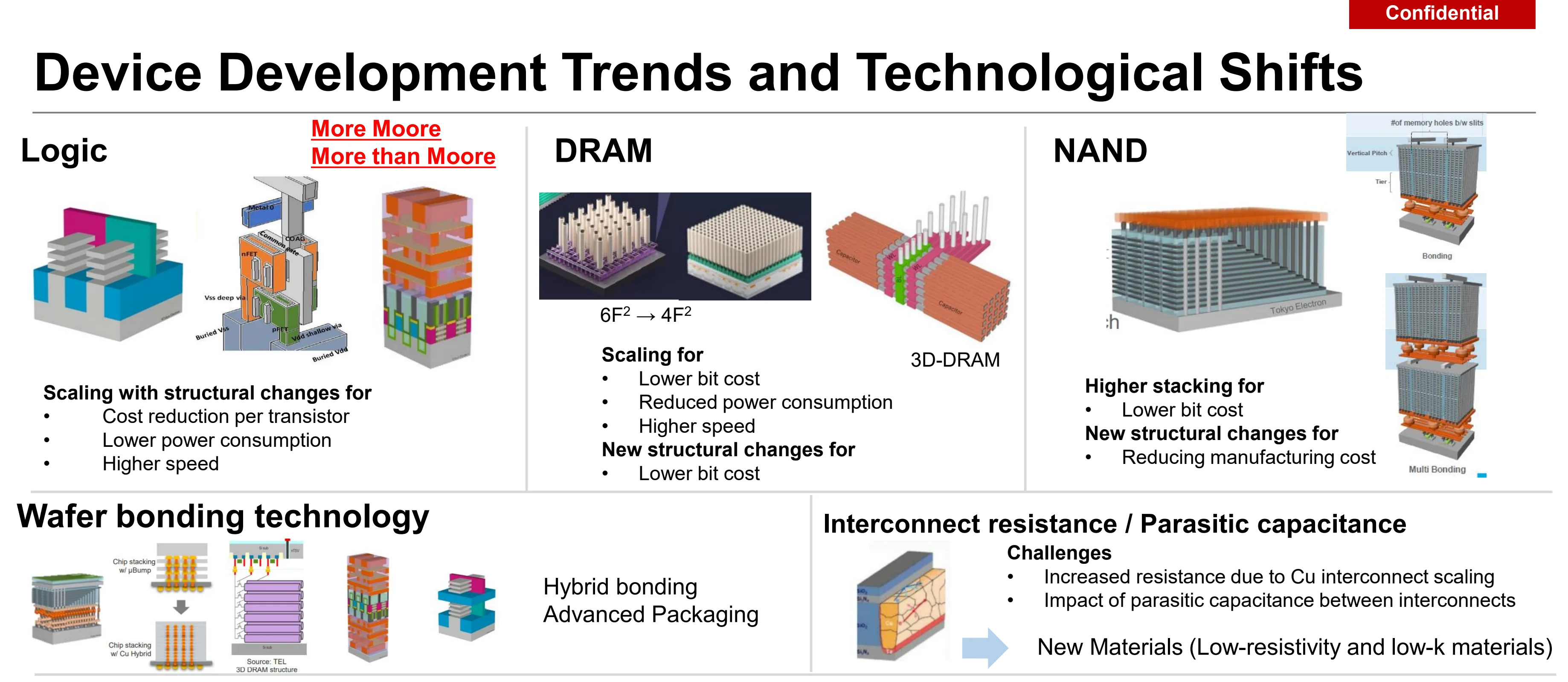

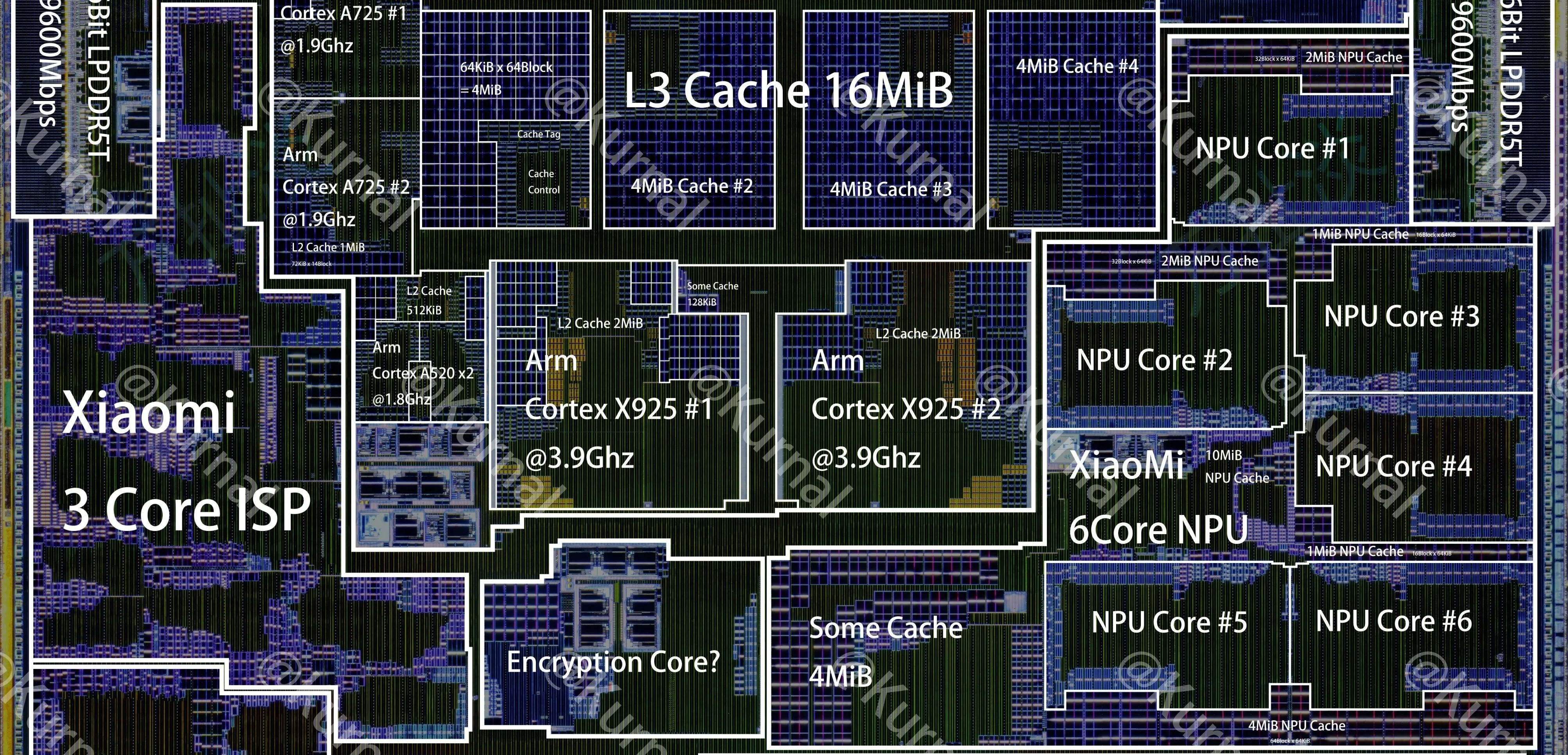

2.1 CPU 与 PCIe 通道 (PCIe Lanes) 的算力博弈

在虚拟化平台中,CPU 核心规模、PCIe 通道规划与 I/O 拓扑,通常比单核峰值频率更关键。

- 消费级 CPU 的边界 (Intel Core / AMD Ryzen): 消费级 CPU(以近几代桌面平台为例)可直连的 PCIe 通道通常有限,且部分 I/O 需要经由芯片组上行链路转发。 当场景包含多设备直通(GPU、10GbE/25GbE 网卡、HBA/NVMe 扩展)时,容易受到通道数量、插槽电气规格和主板分线策略约束,实际性能也可能受芯片组上行带宽影响。

- 企业级/工作站 CPU 的优势 (Intel Xeon / AMD EPYC / Threadripper): 服务器平台的主要优势在于更高核心数、更大的内存上限与更充足的 PCIe 通道预算。例如 AMD EPYC 7002/7003 可提供较多 PCIe 通道,适合多卡直通与高密度 NVMe 场景。

- NUMA 架构提醒: 双路(Dual Socket)平台需要特别关注 NUMA(非一致性内存访问)。跨节点访存会增加延迟与抖动,数据库与低时延业务更敏感。后续【卷四:KVM 调优】会介绍 CPU/内存亲和性与 NUMA 绑定策略。

2.2 内存选型:为什么强烈建议使用 ECC? 🛡️

虚拟化环境对内存容量的渴求是无底洞。

- UDIMM vs RDIMM:消费级主板只能使用 UDIMM(无缓冲内存),单条最大通常为 32GB 或 48GB,四条插满顶多 192GB。而服务器主板支持 RDIMM(寄存器内存)或 LRDIMM(减载内存),单条可达 128GB 甚至 256GB,轻松实现 1TB 以上的总内存。

- ECC (纠错码) 的必要性: 如果你计划在 PVE 中使用 ZFS,ECC 内存应作为强烈建议项。非 ECC 内存发生位翻转时,可能把错误数据带入写入路径,增加静默损坏风险。ECC 能降低这类风险,是存储可靠性链路中的重要一环。

2.3 存储介质:家用 SSD 在 ZFS 下的“性能雪崩” 💾

常见误区是使用消费级 NVMe 直接承载高同步写入负载(数据库、日志、NFS/iSCSI 后端),随后出现延迟抖动或写入性能明显下降。

- 同步写入 (Sync Writes) 与 ZIL 机制: 当上层发起同步写请求时,ZFS 需要满足同步语义后才确认完成。ZIL(准确说是 in-pool ZIL,或外置 SLOG)用于承接这类事务日志路径。

- 掉电保护 (PLP - Power Loss Protection) 的影响: 许多消费级 SSD 不具备完整 PLP 设计,在持续同步写入与断电一致性场景下表现通常弱于企业盘。 企业级 SSD(如 Intel/三星/美光部分数据中心型号)通常具备更完整的掉电保护与稳态写入能力,在 ZFS 的同步写路径中延迟与稳定性更可控。

- 结论:如果用 ZFS 承载虚拟机,优先选择带 PLP 的企业级 SSD;若同步写压力较大,可评估独立 SLOG 设备(如低时延高耐久介质)。

2.4 网卡选型建议:稳定性优先,再谈 SR-IOV 🔌

- Realtek 的使用边界:在轻载 HomeLab 下可用,但在高并发虚拟化网络场景中,稳定性和驱动行为通常不如服务器网卡,建议提前做长时间压力测试。

- Intel i225/i226 注意事项:部分版本或特定链路组合下可能出现协商/丢包问题,部署前建议核对主板 BIOS、NIC 固件、交换机兼容性与内核版本。

- 推荐方向:优先考虑成熟的企业级网卡(如 Mellanox ConnectX 系列、Intel X520/X710 等)。这类网卡通常具备更完善的驱动支持、硬件卸载和 SR-IOV 能力,可减少虚拟交换转发的 CPU 开销。

3. 核心系统安装与底层引导机制解析 ⚙️

了解了硬件,我们进入安装环节的核心机制剖析。

3.1 引导机制判定:GRUB 还是 systemd-boot?

在安装 PVE 时,很多人不知道系统底层是如何引导的,这导致后续配置 IOMMU(硬件直通)修改内核参数时完全不生效。PVE 的引导加载程序取决于你的安装模式和文件系统:

- 如果使用 Legacy BIOS 引导:不论什么文件系统,总是使用 GRUB。

- 如果使用 UEFI 引导,且安装在 ext4/xfs 等传统文件系统:使用 GRUB。

- 如果使用 UEFI 引导,且安装在 ZFS (Root on ZFS) 文件系统:常见安装路径会使用 systemd-boot。

实战排错:

如果你是第三种情况(ZFS+UEFI),修改 /etc/default/grub 通常不会影响当前引导链路。

你需要修改的文件是:/etc/kernel/cmdline

修改完成后,必须执行专有命令来刷新引导:

proxmox-boot-tool refresh底层引导机制判定流程图:

3.2 ZFS 安装的高级参数设定

在 PVE ISO 安装界面,如果你选择 ZFS 作为目标系统,点击 Options 会弹出高级菜单。这里的参数会直接影响性能与可维护性:

- ashift:这是 ZFS 的扇区对齐参数。

ashift=12对应 4K 扇区,适配当前绝大多数 SSD/新盘。若误设为过小值(如ashift=9),可能带来明显写放大与性能损失。 - RAIDZ 与虚拟机随机 I/O:

raidz-1更偏容量利用率,随机写与重建期性能通常不如镜像 vdev。若主要负载是虚拟机和数据库,mirror往往更稳妥。 - compress:默认开启

lz4或zstd。ZFS 的压缩是透明且高效的,由于现代 CPU 算力过剩而硬盘 IO 永远是瓶颈,开启压缩不仅能省空间,往往还能提升读取速度。

3.3 网络接口配置语法精讲 (Interfaces) 🌐

PVE 的网络配置文件位于 /etc/network/interfaces。理解它,是迈向 SDN 的基础。

一个典型的默认网桥配置如下:

auto loiface lo inet loopback

# 物理网卡,不配置 IPiface enp3s0 inet manual

# 虚拟网桥auto vmbr0iface vmbr0 inet static address 192.168.1.100/24 gateway 192.168.1.1 bridge-ports enp3s0 # 将物理网卡绑定到此网桥 bridge-stp off # 关闭生成树协议,加速启动 bridge-fd 0 # 转发延迟设为 0深度解析:vmbr0 就是一台虚拟出来的物理交换机。bridge-ports enp3s0 的意义在于,把物理网卡插到了这台虚拟交换机的 Uplink (上联) 端口上。PVE 宿主机自己也占用了这台交换机的一个虚拟端口,并获取了 192.168.1.100 的 IP。所有虚拟机的虚拟网卡,都会自动插到这台 vmbr0 交换机上。

如果你有第二张网卡 enp4s0,并且不想把它暴露给局域网,而是专门留给虚拟机直通使用,那么在 interfaces 文件中,你只需要保留 iface enp4s0 inet manual,不要把它加入任何 vmbr 的 bridge-ports 中。

3.4 初始化与维护基线(按版本校对)🛠️

PVE 8.x 基于 Debian 12 (Bookworm)。如果你的环境是其他主版本(如 PVE 7/9),请先以当前版本官方仓库命名为准,再执行源配置与升级。

1. 仓库配置与基础工具安装(示例): 以下示例以 PVE 8 + Debian 12 为前提,执行前请先备份仓库文件:

# 1. 替换 Debian 基础源为中科大/清华源sed -i 's/ftp.debian.org/mirrors.ustc.edu.cn/g' /etc/apt/sources.listsed -i 's/security.debian.org/mirrors.ustc.edu.cn/g' /etc/apt/sources.list

# 2. 删除企业订阅源,添加 PVE 无订阅国内源rm -f /etc/apt/sources.list.d/pve-enterprise.listecho "deb https://mirrors.ustc.edu.cn/proxmox/debian/pve bookworm pve-no-subscription" > /etc/apt/sources.list.d/pve-no-subscription.list

# 3. Ceph 仓库请与当前 PVE 主版本匹配(不要硬编码旧代号)# 建议先通过官方文档或 `pveversion -v` 确认对应 Ceph 代号后再写入 ceph.list

# 4. 执行全系统升级apt update && apt dist-upgrade -y

# 5. 安装底层排障与运维利器apt install -y htop iotop iftop ethtool pciutils lshw smartmontools nvme-cli lm-sensors sudo vim git

# 6. 可选:重启相关服务(例如改动网络或内核参数后)# systemctl restart pveproxy.service卷一 完结。 在第一卷中,我们完成了 PVE 架构、硬件选型与安装引导机制的基础梳理,并补充了版本差异与配置风险提示。 下一批次预告:【卷二:ZFS 存储引擎深度解剖与 Ceph 分布式存储实战】。 重点会放在缓存层级、数据一致性与集群部署边界条件。

🗄️ 卷二:ZFS 存储引擎深度解剖与 Ceph 分布式存储实战

导读:在 PVE 中,存储设计直接决定了性能上限与故障恢复能力。LVM/ext4 在很多场景仍然可用,但在一致性校验、快照语义和多副本扩展方面,ZFS/Ceph 通常更有优势。本卷聚焦两条主线:单机侧的 ZFS,以及集群侧的 Ceph。

4. ZFS 存储引擎架构深度解剖 🧱

ZFS (Zettabyte File System) 常被称为“文件系统与卷管理一体化”的代表。它不仅是文件系统,也承担了卷管理与冗余编排能力。其核心思想之一是端到端校验与自管理,而不是完全依赖底层 RAID 控制器。

4.1 ZFS 的核心架构层级

理解 ZFS,必须理解其三个层级:

- VDEV (Virtual Device, 虚拟设备):由一块或多块物理硬盘组成。ZFS 的冗余(如镜像 Mirror、类似 RAID5 的 RAIDZ)是在 VDEV 这一层实现的。

- Zpool (存储池):由一个或多个 VDEV 组成。Zpool 会将数据打散(Striping,类似 RAID0)写入到底层所有的 VDEV 中。

- Dataset / Zvol (数据集/块设备):从 Zpool 中划分出来的空间。

- Dataset:类似传统目录树,可单独设置压缩、配额、快照策略。在 PVE 中常用于 ISO、备份、模板与容器子卷等内容。

- Zvol:类似一个虚拟的物理硬盘(块设备),这是给 KVM 虚拟机当系统盘使用的。

ZFS Dataset 与 Zvol 的架构层级对比:

黄金定律:

- 如果一个 Zpool 由多个顶层 vdev 组成,任意一个顶层 vdev 不可恢复,通常会导致整个池不可用。

- 不建议在硬件 RAID 抽象层之上再叠加 ZFS。更推荐 HBA 直通(常见为 IT 模式),让 ZFS 直接看到物理盘与健康信息。

4.2 缓存架构的艺术:ARC、L2ARC 与 ZIL/SLOG ⚡

这是无数 PVE 新手最容易混淆的区域,也是 ZFS 性能调优的核心。

1. ARC (Adaptive Replacement Cache):内存是最好的硬盘

ZFS 会将最常访问的数据缓存在物理内存中,这就是 ARC。

- 机制:由于内存速度极快,ARC 命中率对读取性能影响很大。Linux 下 ARC 上限由 ZFS 模块参数控制,默认行为通常会占用较大比例内存,并按压力动态回收。

- 内存饥渴:ZFS 倾向利用空闲内存提升缓存命中。当 KVM 虚拟机突发抢占内存时,ARC 会回收,但在资源紧张节点可能出现短时抖动。

- 实战调优 (限制 ARC 大小):

如果你是一台内存只有 32GB 的 All-in-One 机器,建议将 ARC 限制在 4GB-8GB,以保证虚拟机有充足的内存。

Terminal window # 限制最大 ARC 为 8GB (8589934592 字节)echo "options zfs zfs_arc_max=8589934592" > /etc/modprobe.d/zfs.confupdate-initramfs -u -k all

2. L2ARC:用 SSD 加速读取 (二级缓存)

当 ARC(内存)装不下热数据时,ZFS 会把次热的数据驱逐到 L2ARC 设备中。通常这是一块高速的 NVMe SSD。

- 误区:给机械盘池直接加一块 M.2 并不必然大幅提速,是否有效取决于工作集与命中率。

- L2ARC 的代价:L2ARC 需要 ARC 保存元数据,会占用额外内存。若内存本就紧张或工作集不稳定,加入 L2ARC 可能收益有限甚至负收益。建议先看 ARC 命中率与延迟,再决定是否上 L2ARC。

3. ZIL (ZFS Intent Log) 与 SLOG (Separate Intent Log):拯救同步写入

在【卷一】中我们提到过同步写入(Sync Writes)对 SSD 的摧残。

- ZIL:同步写入路径下,ZFS 会先把事务记录到日志路径(默认在池内),满足持久化语义后再确认完成,随后再由事务组写入主数据结构。

- SLOG:可将日志路径迁移到独立低时延设备(通常要求高耐久、低写延迟、具备 PLP)。这块专用日志设备通常称为 SLOG。

- 实战添加 SLOG:它主要改善同步写延迟与抖动,收益高度依赖负载类型与设备本身延迟特性。

Terminal window # 假设你的存储池叫 tank,傲腾盘是 /dev/nvme1n1zpool add tank log /dev/nvme1n1

4.3 ZFS 的高级特性运用 🛠️

- 写时复制 (COW, Copy-On-Write):ZFS 不直接覆写原块,先写新块再切换指针,可显著降低中断写入导致的不一致风险。

- 快照 (Snapshot):得益于 COW,快照创建通常很快,初始空间占用很小;但随着后续数据变更,快照会持续占用历史块空间,需要配合保留策略管理。

ZFS 写时复制 (COW, Copy-On-Write) 与快照原理图:

5. Ceph 分布式存储集群:打造不宕机的数据中心 🕸️

如果说 ZFS 更适合单机或小规模节点内可靠存储,Ceph 更擅长跨节点分布式存储。Proxmox VE 提供了相对完整的 Ceph 集成能力,便于在同一平台完成部署与运维。

5.1 什么是 Ceph 与超融合架构 (HCI)?

传统的虚拟化架构是“计算与存储分离”:前面几台计算服务器(跑虚拟机),后面连着一台巨大的集中式盘柜(SAN/NAS)。盘柜一旦宕机,全网瘫痪。

PVE + Ceph 实现了超融合架构 (Hyper-Converged Infrastructure, HCI): 不需要外接盘柜,将所有 PVE 计算节点本地插满硬盘,通过万兆网络将这些硬盘融合成一个巨大的、跨节点的分布式存储池。

- 虚拟机可以任意漂移:因为数据不在某台具体机器上,而在集群网络中。

- 高可用能力:在副本策略与故障域配置合理的前提下,单节点故障后可由其他节点承接业务;实际恢复时间取决于 HA 策略、资源余量和故障规模。

5.2 Ceph 集群的硬性前置条件 (排雷指南) ⚠️

很多 HomeLab 场景上 Ceph 后体验不佳,核心原因通常是网络、磁盘与资源预算不足。建议先满足这些前置条件:

- 节点与仲裁:生产环境建议至少 3 个节点,并部署奇数个 MON(通常 3 或 5)以保证仲裁与可用性。1~2 节点可做实验,但不适合作为高可用基线。

- 网络带宽与时延:10GbE 通常是可用起点,负载较高时可考虑 25GbE+。Public/Cluster 网络建议隔离,隔离方式可为物理分网卡,也可为可靠的 VLAN/VRF 规划。

- 介质一致性:Ceph 对尾延迟敏感。建议同一池内保持介质与性能等级一致,避免慢盘拖累恢复与业务抖动。

- 资源预算:OSD 数量与内存/CPU 预算强相关;每 OSD 的内存开销与 Ceph 版本、BlueStore 配置、负载模型有关,需结合压测校准。

5.3 核心组件解析

在 PVE 中部署 Ceph,你需要配置三个核心角色:

- MON (Monitor, 监视器):维护集群的状态图(Cluster Map)。必须部署奇数个(如 3 或 5 个)。

- MGR (Manager, 管理器):负责收集性能指标和提供 Dashboard 接口。通常和 MON 部署在一起。

- OSD (Object Storage Daemon, 对象存储守护进程):每块物理硬盘对应一个 OSD 进程。OSD 负责实际的数据读写和数据平衡。

Ceph 核心组件控制面与数据面交互逻辑:

5.4 CRUSH 算法与数据副本机制 🧬

Ceph 没有传统的 RAID 概念。它使用 CRUSH (Controlled Replication Under Scalable Hashing) 算法来决定数据存在哪里。 当你往 Ceph 写入一个文件时:

- 文件被切分成 4MB 大小的对象 (Object)。

- 对象通过 Hash 算法被映射到某个 PG (Placement Group, 归置组) 中。

- CRUSH 算法会计算出这个 PG 应该存在哪几个 OSD (硬盘) 上。

在 PVE 中创建 Ceph 存储池时,关键参数是 size(副本数)和 min_size(最小可写副本数)。

- 常见配置:Size=3, Min. Size=2。

- 含义:单份数据保留 3 个副本,写入至少要求 2 副本可用。该策略在可靠性与可用性之间较均衡,容量利用率约为原始容量的 1/3(未计入元数据与预留空间)。

Ceph CRUSH 寻址与数据写入微观流程:

5.5 PVE GUI 下的 Ceph 实战部署流 🖱️

满足前置条件后,可通过 PVE GUI 完成基础部署:

- 初始化:在每个节点点击

节点 -> Ceph -> 安装 Ceph,选择与当前 PVE 版本兼容的 Ceph 版本。 - 配置网络:按你的网络设计设置 Public/Cluster Network(可物理隔离,也可通过 VLAN 逻辑隔离)。

- 创建 MON/MGR:确保至少 3 个节点上都创建了 MON 和 MGR 服务。

- 创建 OSD:在每个节点上,将作为数据盘的裸盘(必须没有分区和文件系统)创建为 OSD。

- 创建存储池 (Pool):点击

Ceph -> 资源池 -> 创建,例如命名为ceph-vm,根据故障域与容量目标设置Size/Min. Size。勾选添加为存储后,PVE 可直接用于虚拟机磁盘。

完成以上步骤后,你已经搭建了一个可运行的 Ceph 基线环境。上线前仍建议补齐压测、故障演练与告警。

卷二 完结。 在本卷中,我们梳理了 PVE 存储体系的两条主线:单机侧 ZFS(含 ARC/L2ARC/ZIL/SLOG)与集群侧 Ceph(含副本与组件协作)。 下一批次预告:【卷三:软件定义网络 (SDN)、OpenvSwitch 与高级路由策略】。 我们将抛弃简单的 Linux Bridge,进入网络的高阶玩法,利用 OVS 构建虚拟 VPC、VLAN 隔离以及复杂的 PVE 路由策略。

🌐 卷三:软件定义网络 (SDN)、OpenvSwitch 与高级路由策略

导读:网络是虚拟化的关键底座。默认 Linux Bridge (

vmbr0) 在单机或简单网络里足够稳定,但在多 VLAN、跨节点互联或复杂租户隔离场景下,往往需要更体系化的方案。本卷聚焦 Open vSwitch (OVS) 与 PVE SDN 的实战边界。

6. 打破传统网桥的限制:拥抱 Open vSwitch (OVS) 🌉

默认 Linux Bridge 虽然简单稳定,但在大规模 VLAN、精细 QoS 和隧道编排场景下,配置与运维复杂度会明显上升。

Open vSwitch (OVS) 是工业级虚拟交换机,被广泛用于 OpenStack 等云平台。它的核心价值在于可编程流表与网络编排能力,而不是“在所有场景下都更快”。

OVS (Open vSwitch) 多层架构与流表 (Flow Table) 原理:

6.1 安装 OVS 并在 PVE 中启用

PVE 原生支持 OVS,但默认不安装。我们需要手动安装:

apt updateapt install openvswitch-switch -y生产环境建议先在带外管理链路或测试节点验证,再迁移管理口,避免远程断连。

6.2 OVS 三剑客:OVS Bridge、OVS Port、OVS IntPort

安装完成后,在 PVE 图形界面的 网络 -> 创建 菜单中,你会看到三个新的选项:

- OVS Bridge (OVS 网桥):类似于一台物理的网管型交换机。

- OVS Port (OVS 端口):相当于交换机上的一个物理网口,通常用来绑定宿主机上的真实物理网卡,并配置为 Trunk(允许多个 VLAN 通过)。

- OVS IntPort (OVS 内部端口):相当于给这台虚拟交换机本身配置的一个虚拟管理接口(可以分配 IP),以便宿主机能通过特定的 VLAN 与网络通信。

6.3 实战:单网卡单线复用 (Trunk) 与多 VLAN 隔离 🔀

场景:你有一台 PVE 只有一个物理网口 (enp3s0),连接到一台支持 802.1Q VLAN 的物理交换机。你希望 PVE 上跑不同的虚拟机,分别属于 VLAN 10(办公网)和 VLAN 20(访客网),同时 PVE 管理地址位于 VLAN 99。

配置方法 (修改 /etc/network/interfaces):

auto loiface lo inet loopback

# 物理网卡作为底层链路,不需要 IPiface enp3s0 inet manual ovs_type OVSPort ovs_bridge vmbr0

# 创建一个 OVS 交换机,将物理网卡接上来auto vmbr0iface vmbr0 inet manual ovs_type OVSBridge ovs_ports enp3s0 vlan99

# 创建一个 OVS 内部端口,用于 PVE 宿主机自身的管理auto vlan99iface vlan99 inet static address 192.168.99.10/24 gateway 192.168.99.1 ovs_type OVSIntPort ovs_bridge vmbr0 ovs_options tag=99 # 标记此接口的数据包打上 VLAN 99 标签前置条件:交换机连接 PVE 的端口必须配置为 Trunk,并放行 VLAN 10/20/99,同时确认管理 VLAN 的网关与 ACL 已放通。

应用配置前建议在控制台或 IPMI/iDRAC 会话中操作。提交后优先使用 ifreload -a(ifupdown2)而不是直接重启宿主机。

如何在虚拟机中使用 VLAN?

在虚拟机的 硬件 -> 网络设备 (net0) 中,桥接依然选择 vmbr0,但在 VLAN 标签 栏中填入 10 或 20。

OVS 会按网卡的 VLAN Tag 进行二层转发:虚拟机报文进入 vmbr0 后会按配置加/解标签,再经 enp3s0 发往交换机,从而实现二层隔离。

7. PVE SDN (软件定义网络) 模块:构建虚拟 VPC ☁️

PVE 提供了 SDN (Software-Defined Network) 能力。根据 Zone 类型不同,可基于 Linux Bridge 或 OVS 实现跨节点网络编排。其核心应用场景是:跨节点构建隔离的虚拟网络。

7.1 SDN 核心概念:Zone 与 VNet

在 PVE 的 数据中心 -> SDN 中,有两个最核心的概念:

- Zone (区域):定义了网络的底层实现方式。例如:

- Simple (简单):单机内部的隔离网络(使用 NAT 或空路由)。

- VLAN:基于传统 802.1Q 的跨节点网络。

- VXLAN:基于 UDP 封装的隧道技术,适合把不同三层网络上的节点连接到同一逻辑二层。

- VNet (虚拟网络):在 Zone 之上创建的具体网络。虚拟机在添加网卡时,直接连接到 VNet,而不是传统的

vmbr0。

7.2 实战构建 VXLAN 大二层隧道网络 🚇

场景:

- 节点 A:物理 IP

10.0.0.10(在机房 A) - 节点 B:物理 IP

172.16.0.10(在机房 B) - 需求:在两台节点上各自创建一台虚拟机,它们的 IP 分别是

192.168.200.11和192.168.200.12,要求它们能像插在同一台交换机上一样互相 Ping 通。

SDN 配置步骤:

- 全局配置:进入

数据中心 -> SDN -> 选项,点击Apply初始化 SDN 配置文件(这一步是前置,必须点一次)。 - 创建 Zone:进入

SDN -> Zones -> 添加 -> VXLAN。- ID 填

vxzone1 - Peers(对端):填入所有节点的物理 IP,如

10.0.0.10,172.16.0.10。

- ID 填

- 创建 VNet:进入

SDN -> VNets -> 添加。- Name 填

vnet200 - Zone 选择刚创建的

vxzone1 - Tag 填

20000(作为 VXLAN VNI,需保证在你的环境中唯一)。

- Name 填

- 应用 SDN 配置:回到

数据中心 -> SDN主页面,点击上方的 “应用” (Apply)。PVE 会下发对应网络配置;若启用了相关高级功能,可能会联动 FRR 等组件。

关键检查项:确保节点间 UDP 4789(VXLAN)可达,underlay MTU 预留封装开销(常见做法是底层 MTU 适当增大),否则会出现丢包或性能抖动。

连接虚拟机:

现在回到虚拟机网卡配置,桥接下拉菜单会出现 vnet200。将两台虚拟机都接入该 VNet,并配置 192.168.200.x 地址后,通常可实现二层互通。

VXLAN 大二层数据包 UDP 封装与解封装微观剖析:

8. All-in-One 高级网络架构:直通网卡与虚拟网卡的博弈 🕹️

在 HomeLab 场景里,常见做法是用 PVE 运行 OpenWrt/iKuai 等软路由。这会涉及网卡“直通(Passthrough)”与“桥接(Bridged)”两种取舍。

8.1 半直通 (VirtIO 桥接)

这是最常见、最灵活的方案。所有物理网卡(如 eth0, eth1, eth2)都分别创建出 vmbr0, vmbr1, vmbr2。

软路由虚拟机添加三个虚拟网卡,分别桥接到这三个 vmbr 上,模型选择 VirtIO。

- 优点:PVE 宿主机随时可以利用这些网卡,其他虚拟机(如 NAS, 旁路由)也可以随意接入这些网桥,网络拓扑极其灵活。

- 缺点:报文需要经过宿主机转发路径。在高并发(如 2.5G/10G 测速)下,CPU 占用与中断压力通常会升高。

经典 All-in-One 软路由网络拓扑图:

8.2 PCI 全硬件直通 (PCIe Passthrough)

在【卷一】中我们讲过如何开启 IOMMU。将用于 WAN 口和 LAN 口的物理网卡直接作为一个 PCI 设备分配给软路由虚拟机。

- 优点:性能和时延可预测性通常更好,转发路径更短,宿主机转发开销更低。

- 缺点:独占。被直通的物理网卡对 PVE 宿主机来说彻底消失了。其他虚拟机无法再连接到这个物理网口。

- 拓扑困境与解决:

假设你把两个物理网口直通给了 OpenWrt,那么 PVE 里的其他虚拟机(如群晖、Ubuntu)怎么上网?

- 解法 1 (外部交换机回环):将 OpenWrt 的直通 LAN 口接到外部交换机,同时把 PVE 管理口也接入该交换机。其他虚拟机桥接

vmbr0,流量经交换机回到 OpenWrt。

- 解法 1 (外部交换机回环):将 OpenWrt 的直通 LAN 口接到外部交换机,同时把 PVE 管理口也接入该交换机。其他虚拟机桥接

外部交换机物理回环 (Hairpin) 拓扑图:

* **解法 2 (添加虚拟 LAN 口)**:给 OpenWrt 虚拟机添加一个额外的 `VirtIO` 虚拟网卡,桥接到内部的 `vmbr0`。在 OpenWrt 系统里,将这个虚拟网卡与直通的物理 LAN 网卡放在同一个 LAN 桥接组里。这样,PVE 内部的虚拟机就能走内部虚拟总线直连 OpenWrt。8.3 终极杀器:SR-IOV 网卡切分架构 ⚔️

如果你有一张支持 SR-IOV 的企业级网卡(例如 Intel X520/X710, Mellanox ConnectX-3/4),这才是 All-in-One 网络的真正终点。

SR-IOV (Single Root I/O Virtualization) 技术允许网卡在其自身的硬件芯片上,生成成百上千个“虚拟功能(VF, Virtual Function)”。

- 这种架构的优势在于:

- 更低的宿主机转发开销:VF 直通后,部分数据路径可减少软交换参与,但仍依赖具体驱动与功能开关。

- 潜在的硬件交换能力:部分网卡支持 VF 间硬件交换(VEB/embedded switch),可降低时延并提升吞吐;是否生效取决于网卡型号、固件与安全策略配置。

SR-IOV 网卡芯片内部 VEB (虚拟以太网桥) 交换机制:

(具体如何在 PVE 中开启 SR-IOV 并分配 VF,我们将在【卷五:终极硬件直通】中给出详尽的实战代码)

卷三 完结。 本卷我们覆盖了从 OVS 单线复用,到 VXLAN 跨节点互联,再到 All-in-One 场景下桥接、直通与 SR-IOV 的取舍逻辑。 下一批次预告:【卷四:KVM 与 LXC 的极致性能调优】。 为什么你的 Windows 虚拟机卡顿、掉帧?我们将深入探讨 CPU 的 Host 模式底层指令集、NUMA 节点绑定、Qemu Agent 增强工具以及 LXC 容器权限的安全穿透。

🚀 卷四:KVM 与 LXC 的极致性能调优

导读:许多用户抱怨在 PVE 中运行 Windows 虚拟机不如在 VMware ESXi 中流畅。这往往不是 KVM 本身的问题,而是默认配置与业务负载不匹配。本卷将聚焦 CPU 指令集、NUMA、QEMU Guest Agent 与 LXC 权限模型,帮助你获得更稳健的性能。

9. KVM 虚拟机 CPU 与内存的硬核调优 🧮

在创建虚拟机时,CPU 和内存的分配绝不是简单地填两个数字。错误的分配方式会导致宿主机频繁的上下文切换(Context Switch),极大地拖垮性能。

9.1 CPU 模型选择:何时使用 Host?

在虚拟机的 硬件 -> 处理器 -> 类别 (Type) 中,PVE 默认选择的是 kvm64 或 x86-64-v2-AES。

- 默认模型的代价:这些默认模型是为了最高兼容性而设计的。这意味着,如果你的物理机是最新款的 13900K,KVM 会为了兼容性,向虚拟机隐藏大量先进的指令集(如 AVX-512, AES-NI 等),只暴露最基础的 x86 指令。结果就是,虚拟机在进行视频解码、加密解密时,速度惨不忍睹。

- Host 模式的收益:

Host会暴露更多宿主机指令集,常见于追求单机性能或固定节点运行的业务。 - 迁移约束:在集群环境下,

Host可能限制跨节点热迁移能力。若需要 Live Migration,通常应选择各节点共同支持的 CPU 模型。

9.2 CPU 拓扑、插槽 (Sockets) 与核心 (Cores)

- Sockets (插槽):代表物理 CPU 的数量。如果你给一个 Windows 10 家庭版分配了 2 个 Sockets,它只能识别到 1 个(因为 Windows 家庭版有单 CPU 授权限制)。

- Cores (核心):代表每个 Socket 里的核心数。

- 常见实践:优先用

1 Socket + N Cores,可避免部分来宾系统的多插槽限制;但仍需按授权与应用特性调整。

9.3 终极性能:CPU 绑核 (CPU Pinning) 与隔离 📌

如果你的虚拟机承载了极高负载的任务(如游戏串流、实时交易系统),你不希望它的线程在物理机的不同核心之间跳来跳去。你可以通过修改虚拟机的配置文件 (/etc/pve/qemu-server/<VMID>.conf) 来实现硬绑核。

实战绑核配置: 推荐使用 PVE 原生参数,而不是手写不兼容的 QEMU 参数。示例:

# 假设物理机有 16 个核心 (0-15),希望此 VM 仅在 4-7 上运行affinity: 4-7也可用命令行设置:

qm set <VMID> --affinity 4-7更进一步可在宿主机配合 CPU 隔离策略(如 isolcpus / cpuset)降低干扰,但需要结合内核版本与系统服务做完整验证。

示例内核参数:

GRUB_CMDLINE_LINUX_DEFAULT="quiet intel_iommu=on isolcpus=4-7"CPU 隔离 (isolcpus) 与硬绑核 (Pinning) 架构图:

9.4 内存的 Ballooning (气球驱动) 机制 🎈

气球机制允许宿主机根据虚拟机的实际内存使用量,动态回收和分配内存。

- 原理:气球依赖来宾系统中的

virtio-balloon驱动(并非 QGA 本体)。当宿主机内存紧张时,会回收来宾可回收页。

KVM 内存气球 (Memory Ballooning) 挤压原理图:

- 避坑:对数据库、JVM、大型缓存等对内存稳定性敏感的负载,通常建议禁用 Balloon 或设置较高最小内存,避免频繁回收导致抖动。

10. QEMU Guest Agent (QGA):打破次元壁的使者 🕵️♂️

很多新手在 PVE 界面发现虚拟机的 IP 地址无法显示,或者点击“关机”按钮时虚拟机没有任何反应(只能硬拔电源),这是因为没有安装 QEMU Guest Agent (QGA)。

10.1 QGA 的核心作用

QGA 是运行在虚拟机操作系统内部的一个服务,它是宿主机(PVE)和虚拟机之间沟通的桥梁。

- 优雅关机 (Graceful Shutdown):PVE 点击关机时,会通过 QGA 发送 ACPI 关机信号给虚拟机内的操作系统,使其正常保存数据并关机。

- IP 与状态报告:将虚拟机获取到的 IP 地址实时显示在 PVE 的摘要面板上。

- 冻结文件系统 (FSTRIM/Fsfreeze):在 PVE 执行备份或快照时,QGA 会通知虚拟机内的文件系统暂停一切写入(Freeze),确保备份的一致性。备份完成后再解冻(Thaw)。

10.2 安装与启用 QGA

步骤 1:PVE 侧启用

在 PVE 网页端,选中虚拟机 -> 选项 -> QEMU Guest Agent,双击开启。通常重启来宾系统即可让设备生效;若未识别,再执行一次 Stop/Start。

步骤 2:虚拟机内部安装

- Linux (Debian/Ubuntu):

Terminal window apt update && apt install qemu-guest-agent -ysystemctl enable qemu-guest-agent --now - Windows:

下载 PVE 官方提供的 VirtIO 驱动光盘 ISO(

virtio-win.iso),挂载给虚拟机。 进入光盘目录,找到guest-agent文件夹,运行安装程序即可。

11. LXC 容器的性能魔法与特权穿透 🔓

LXC 是 PVE 的核心能力之一,但其权限隔离机制(AppArmor + User Namespace)会增加 Docker 嵌套和设备映射的配置复杂度。

11.1 特权容器 (Privileged) vs 无特权容器 (Unprivileged)

在创建 CT 容器时,有一个 无特权容器 的勾选项(默认勾选)。

- 无特权容器 (Unprivileged):极其安全。容器内的

root用户(UID 0)会被映射到宿主机上的一个极大的非特权 UID(例如 100000)。即使容器被黑客攻破并拿到了 root,他在宿主机眼里也只是一个毫无权限的普通用户。 - 特权容器 (Privileged):容器内 root 与宿主机权限边界更弱,硬件直通更容易,但安全风险更高。

无特权容器 (Unprivileged LXC) 的 UID 命名空间映射原理:

11.2 实战 1:在无特权 LXC 中运行 Docker 🐳

通常优先使用无特权容器。要在无特权 LXC 中跑 Docker(Docker in LXC),可按以下步骤:

- 创建容器:勾选

无特权容器。 - 开启嵌套 (Nesting):进入容器的

选项 -> 功能 (Features),勾选嵌套 (keyctl, nesting)。这一步是允许容器内再次创建命名空间(Docker 的运行基础)。 - 在容器内安装 Docker 并验证驱动:

docker info | grep -i "Storage Driver"。 - 存储驱动注意:不同内核与存储后端下,

overlay2可用性会有差异;若出现兼容性问题,性能可能明显下降。生产场景建议先压测再上线。

11.3 实战 2:LXC 硬件直通 (核显 GPU / USB 透传) 🎬

与 KVM 虚拟机通过 PCIe VFIO 硬件直通不同,LXC 共享宿主机的内核,因此直通硬件极其简单——只需要把宿主机上的设备文件映射进容器即可。

以直通 Intel 核显 (用于 Jellyfin/Plex 硬解) 为例:

假设你想把宿主机的 /dev/dri/renderD128 (核显) 透传给 ID 为 101 的无特权 LXC 容器。

- 在宿主机查看设备信息和所属组:

记住主设备号

Terminal window ls -l /dev/dri/renderD128# 输出示例:crw-rw---- 1 root render 226, 128 Oct 1 12:00 /dev/dri/renderD128226,次设备号128,以及所属组render(GID 通常是 104)。 - 修改容器配置文件

/etc/pve/lxc/101.conf,追加以下配置:# 允许容器读取 226 这个字符设备lxc.cgroup2.devices.allow: c 226:128 rwm# 将宿主机的 renderD128 挂载到容器内的相同路径lxc.mount.entry: /dev/dri/renderD128 dev/dri/renderD128 none bind,optional,create=file# 无特权容器需额外处理 UID/GID 映射,确保容器用户对该设备有读写权限 - 在宿主机调整设备权限映射(推荐通过组和 udev 规则):

Terminal window # 反例:不要对设备使用 777# chmod 777 /dev/dri/renderD128## 推荐:使用 render/video 组 + 持久化 udev 规则,或在可接受风险下改用特权容器

启动容器后,在容器内执行 ls -l /dev/dri/ 与 vainfo 验证设备访问和硬解能力。

LXC 容器硬件设备映射穿透流程:

卷四 完结。 本卷我们梳理了 KVM 的 CPU/内存调优思路、QEMU Guest Agent 的使用边界,以及 LXC 在安全与可用性之间的权衡。 下一批次预告:【卷五:终极硬件直通 (PCIe Passthrough) 实战】。 准备好进入 PVE 最硬核、最容易蓝屏重启的领域了吗?我们将挑战 PCIe IOMMU 拆分、ACS 补丁、GPU (显卡) 直通、Error Code 43 破解以及 SR-IOV 虚拟化的手把手教学!

🌋 卷五:终极硬件直通 (PCIe Passthrough) 与 SR-IOV 虚拟化

导读:硬件直通是 PVE 最有价值也最容易踩坑的功能之一。当你把 GPU/NIC 独占交给虚拟机时,需要同时处理 BIOS、IOMMU 拓扑、驱动绑定与迁移策略。本卷聚焦可复现的排障路径,而不是“通杀参数”。

12. PCIe 直通的底层逻辑与 IOMMU 分组 🧩

12.1 什么是 IOMMU 与 VFIO?

IOMMU (Intel VT-d 或 AMD-Vi) 是一种硬件内存管理单元。它的作用是防止外设恶意或错误地读取不属于它的内存区域。 VFIO 是 Linux 内核的一个驱动框架。当你要把一个 PCIe 设备(比如显卡)直通给虚拟机时,VFIO 驱动会接管这个设备,把它和宿主机(PVE 本身)完全隔离开来。

12.2 致命的 IOMMU 分组 (IOMMU Groups) 🛑

直通不是你想通哪个设备就能通的,直通的最小单位是 IOMMU Group(组)。

- 规则:同一 IOMMU Group 内设备隔离边界不完整。若只直通其中一个设备,常见结果是直通失败、设备重置异常或宿主机不稳定。

- 验证分组:在 PVE 的 Shell 中运行以下脚本,查看你的硬件分组:

如果目标设备与关键板载控制器(如 SATA/USB)混在同组,建议优先更换插槽/主板或调整硬件拓扑,再考虑 ACS 方案。

Terminal window for d in /sys/kernel/iommu_groups/*/devices/*; do n=${d#*/iommu_groups/*}; n=${n%%/*}; printf 'IOMMU Group %s ' "$n"; lspci -nns "${d##*/}"; done;

灾难级的 IOMMU 分组拓扑示例 (为什么不能单独直通):

12.3 开启直通的四步曲 (标准流程) 📜

- BIOS 设置:开启

Intel VT-d/AMD-Vi(并建议同时开启 Above 4G Decoding,按平台能力配置)。 - 修改内核参数 (

/etc/kernel/cmdline对于 ZFS+UEFI,或/etc/default/grub对于传统引导):intel_iommu=on iommu=pt# 或者 amd_iommu=on iommu=pt - 加载必要的内核模块 (

/etc/modules):vfiovfio_iommu_type1vfio_pci - 刷新并重启:

Terminal window # ZFS + UEFI 常见路径proxmox-boot-tool refresh# GRUB 引导路径需执行# update-grubupdate-initramfs -u -k allreboot

13. 显卡直通 (GPU Passthrough) 实战与避坑 🎮

直通显卡通常用于两个场景:1. Windows 游戏/推流虚拟机;2. Linux AI 炼丹/CUDA 计算节点。

13.1 屏蔽宿主机显卡驱动

如果你要直通显卡,需要避免宿主机先占用目标设备。更推荐按 PCI ID 进行 vfio-pci 定向绑定,而不是全局黑名单所有图形/音频驱动。

以下“全局黑名单”仅适用于宿主机完全不需要本地图形输出的场景:

blacklist nouveaublacklist radeonblacklist amdgpu# 注意:不要无差别屏蔽宿主机关键总线/音频驱动,避免影响其他设备(多显卡场景应优先使用 13.2 的 vfio 按 ID 绑定方式。)

13.2 使用 VFIO 绑定特定设备 (多显卡/同型号显卡终极解法) 🎭

如果你有两张一模一样的显卡(比如两张 RTX 3090),你想把第一张留给 PVE 宿主机(虽然这很浪费),把第二张直通给虚拟机。你不能使用黑名单,因为这会同时屏蔽两张卡。

你需要使用 vfio-pci 驱动,根据设备的硬件 ID 强行绑定:

- 找到显卡及其自带声卡的硬件 ID:

Terminal window lspci -nn | grep -i nvidia# 输出示例:# 01:00.0 VGA compatible controller [0300]: NVIDIA Corporation Device [10de:2204]# 01:00.1 Audio device [0403]: NVIDIA Corporation Device [10de:1aef] - 编辑

/etc/modprobe.d/vfio.conf,将这两个 ID 填入:options vfio-pci ids=10de:2204,10de:1aef - 更新 initramfs 与引导配置后重启。开机时目标设备会优先绑定到

vfio-pci,等待虚拟机接管。

VFIO-PCI 抢占式驱动绑定启动时序:

13.3 关于 NVIDIA Error Code 43 (旧环境) 🕵️

在较老驱动/老显卡组合中,可能出现 Error Code 43。新版本驱动通常已显著改善该问题,建议先在默认参数下验证。

如确实命中旧问题,可在测试环境尝试以下兼容参数,并记录回滚点:

cpu: host,hidden=1,flags=+pcidargs: -cpu 'host,-hypervisor,kvm=off'13.4 虚拟机的正确姿势

在 PVE 网页端给虚拟机添加直通显卡时:

- 机器模型:通常推荐

q35。 - BIOS:通常推荐

OVMF (UEFI)。 - 勾选 所有功能 (All Functions)(确保显卡和显卡上的声卡一起直通)。

- 勾选 PCI-Express (PCIe)(告诉虚拟机这是一个插入主板 PCIe 插槽的真实设备)。

- 勾选 主 GPU (Primary GPU)(如果在虚拟机内黑屏,尝试取消这个勾选,通过 RDP 远程桌面连接进去安装驱动后再勾回来)。

14. 终极杀器:SR-IOV 网卡切分架构详解 🕸️

如果你希望减少 NIC 独占问题并降低软交换开销,可以评估 SR-IOV。这里以 Intel X520/X710 或 Mellanox ConnectX 为例。

14.1 开启网卡的 SR-IOV 功能

以 Intel 网卡为例(ixgbe/i40e),建议优先使用 sysfs 或厂商文档推荐方式设置 VF 数量。不同驱动版本对 max_vfs 的支持行为可能不同。

常见临时方式(重启后失效):

echo 4 > /sys/class/net/<PF_IFACE>/device/sriov_numvfs若需持久化,请结合 systemd 单元或网络启动脚本在开机时写入,并先确认交换机侧的 SR-IOV/VLAN 安全策略。

14.2 验证与分配 VF (Virtual Function)

重启后,运行 lspci | grep Ethernet,你会惊喜地发现,除了原本的 2 个物理网卡(PF),多出了 8 个名为 Virtual Function 的以太网控制器。每个 VF 都有自己独立的 PCIe 地址(例如 02:10.0)。

如何在 PVE 中使用这些 VF? 可通过“添加 PCI 设备”把 VF 分配给虚拟机,但建议配合稳定映射(如资源映射/按设备标识管理),避免因 BDF 漂移导致启动失败。

建议的分配方式:

- 在虚拟机的

硬件面板,点击添加 -> PCI 设备,选择具体 VF(或已配置的稳定映射)。 - 在宿主机确认 VF 的 MAC/VLAN/anti-spoof 策略,避免链路通而业务不通。

性能验证:启动虚拟机后可看到对应 VF 网卡。实际吞吐与 CPU 占用取决于驱动、offload、RSS 队列和交换机配置。

15. ACS 补丁 (ACS Override Patch):危险的最后的倔强 ☣️

如果你的 IOMMU 分组非常糟糕(例如主板芯片组把所有 PCIe 插槽都分到了同一个巨大的组里),导致你无法单独直通显卡,你面临两个选择:换主板,或者使用 ACS 补丁。

ACS (Access Control Services) 是 PCIe 的隔离特性。开启 ACS override 会让内核以“逻辑拆分”方式暴露更细 IOMMU 分组,但这不等价于真实硬件隔离能力提升。

如何开启(仅限实验环境): 修改引导内核参数,追加:

pcie_acs_override=downstream,multifunction(注意:这会削弱安全边界并可能带来不可预期行为。生产环境优先方案仍是更换拓扑或硬件平台。)

卷五 完结。 本卷我们梳理了硬件直通的关键路径:IOMMU 分组判定、VFIO 设备绑定、GPU 兼容性排障,以及 SR-IOV/ACS 的适用边界。 下一批次预告:【卷六:高可用集群 (HA)、容灾备份 (PBS) 与 IaC 自动化】 (最终卷)。 当单机性能已到上限,如何把多台 PVE 组织成可恢复、可演练、可审计的集群体系?终章见!

🏆 卷六:高可用集群 (HA)、容灾备份 (PBS) 与 IaC 自动化

导读:单机性能再强,也无法覆盖断电、硬件损坏和误操作风险。在企业与进阶 HomeLab 场景中,核心问题是可用性与可恢复性。本章聚焦 PVE 集群仲裁、QDevice 与 PBS 备份体系。

16. 构建 PVE 高可用集群 (Cluster) 🏘️

PVE 的集群系统基于底层的 Corosync(用于集群通信与心跳)和 Pacemaker(用于资源和 HA 管理)。

16.1 集群的铁律:Quorum (法定人数) 与脑裂 (Brain Split)

- 什么是 Quorum? 集群中必须有超过半数的节点存活并保持通信,集群才能正常工作(即拥有 Quorum)。

- 脑裂灾难:如果你只有 2 个节点 (A 和 B) 组成集群。某天它们之间的网线断了。A 以为 B 死了,B 以为 A 死了。如果它们都试图接管原本在对方身上运行的高可用虚拟机,就会导致两个相同的虚拟机同时往同一个共享存储写数据,瞬间造成整个存储池的数据彻底损坏。这就是脑裂。

- 解决方案:为了防止脑裂,2 节点场景需要额外仲裁票(如 QDevice)才有工程可用性。生产 HA 一般建议 3 节点或 2 节点 + 仲裁设备方案。

高可用 (HA) 故障转移与防脑裂 (Fencing) 状态机机制:

16.2 两节点集群的仲裁补足:QDevice ⚖️

若只有 2 台 PVE,可引入 QDevice (Quorum Device) 补足仲裁票。 QDevice 可运行在轻量 Linux 主机上(树莓派/小云主机均可),它不承载虚拟机,只参与仲裁。

实战:在树莓派 (Debian) 上配置 QDevice:

- 在树莓派上安装服务端:

Terminal window apt update && apt install corosync-qnetd -y - 在所有的 PVE 节点上安装客户端:

Terminal window apt update && apt install corosync-qdevice -y - 在 PVE 节点 A 上执行绑定命令(假设树莓派的 IP 是

192.168.1.50):Terminal window pvecm qdevice setup 192.168.1.50

完成后运行 pvecm status,确认 Expected votes 与 Total votes 符合预期。单节点故障后是否能继续承载业务,还取决于共享存储、HA 组约束和剩余资源容量。

16.3 配置 HA (高可用)

拥有了 3 票的集群和共享存储(如【卷二】中部署的 Ceph,或者外部的 NFS/iSCSI NAS)后:

- 进入 PVE 网页端:

数据中心 -> HA -> 组。创建一个组,选中你的几个 PVE 节点,设置优先级(谁优先跑虚拟机)。 - 进入

数据中心 -> HA -> 资源。添加一台配置在共享存储上的虚拟机,绑定到刚才创建的组。

故障演练:可在维护窗口做受控断电/隔离测试。常见情况下,心跳超时后 HA 会在其他节点重启虚拟机;具体 RTO 取决于检测超时、启动耗时与存储恢复速度。

17. 灾难恢复:Proxmox Backup Server (PBS) 🛡️

PVE 的 vzdump 在不同存储目标上的行为不同。若备份到普通目录/NFS,空间增长通常更快;接入 PBS 后可利用去重与增量机制显著降低传输与存储开销。

Proxmox Backup Server (PBS) 是一个独立的开源系统。它可以直接安装在物理机上,或者作为一台虚拟机运行。

17.1 PBS 的三大关键能力

- 增量传输:PBS 通过块变更识别减少重复传输。收益取决于日常变更量与备份窗口。

- 全局去重 (Deduplication):跨 VM/时间片进行块级去重,可显著降低空间占用,具体节省比例取决于数据相似度。

PBS 全局重复数据删除 (Deduplication) 底层逻辑图:

- 文件级恢复 (File-level Restore):无需整机回滚即可提取单个文件,适合误删场景。

17.2 PBS 部署与对接指南

- 安装 PBS:下载 PBS 的 ISO 镜像并安装(过程与安装 PVE 几乎一模一样)。建议给 PBS 配置大容量机械硬盘并开启 ZFS 压缩。

- 创建 Datastore:登录 PBS 的网页端(端口 8007),在

Datastore菜单下创建一个数据存储区(指向你的大容量硬盘目录)。 - 获取指纹 (Fingerprint):在 PBS 的

Dashboard点击Show Fingerprint并复制这串长长的字符。 - 在 PVE 中对接:回到 PVE 的

数据中心 -> 存储 -> 添加 -> Proxmox Backup Server。- 填入 PBS 的 IP、管理员账号 (

root@pam) 和密码。 - 粘贴刚才复制的指纹。

- 填入 PBS 上创建的 Datastore 名称。

- 填入 PBS 的 IP、管理员账号 (

- 配置定时备份:在 PVE 的

数据中心 -> 备份中,添加一个备份任务,目标存储选择刚才添加的 PBS,勾选你要备份的虚拟机。

完成对接后,建议立即做“备份可恢复性演练”(整机恢复 + 文件级恢复),确保策略可用而不只是“有备份”。

18. 极客进阶:PVE 自动化与 IaC (Infrastructure as Code) 🧑💻

当你的环境越来越大,点鼠标创建虚拟机就成了极其低效且容易出错的苦差事。高级玩家和运维工程师会使用代码来定义基础设施。

18.1 Cloud-Init 的魔法 ☁️

PVE 原生支持 Cloud-Init,这是公有云(如 AWS/阿里云)用来初始化虚拟机的行业标准。

- 下载 Cloud 镜像:去 Ubuntu 官网下载

ubuntu-22.04-server-cloudimg-amd64.img(这是一种预装了 Cloud-Init 且极其精简的 QCOW2 镜像)。 - 创建模板 (CLI 实战):

Terminal window # 创建一个虚拟机 ID 为 9000qm create 9000 --memory 2048 --core 2 --name ubuntu-template --net0 virtio,bridge=vmbr0# 导入 Cloud 镜像到 local-lvm 存储qm importdisk 9000 ubuntu-22.04-server-cloudimg-amd64.img local-lvm# 将导入的磁盘挂载给虚拟机qm set 9000 --scsihw virtio-scsi-pci --scsi0 local-lvm:vm-9000-disk-0# 添加 Cloud-Init 专用的 CD-ROMqm set 9000 --ide2 local-lvm:cloudinit# 设置从 SCSI 硬盘引导qm set 9000 --boot c --bootdisk scsi0# 转换为模板qm template 9000 - 秒级克隆:以后只需要右键克隆这个模板。在克隆出的虚拟机的

Cloud-Init选项卡中,填入你想要的静态 IP、用户名和 SSH 公钥。点击开机,系统会在首次启动时自动配置好网络和用户。你甚至不需要打开控制台,直接用 SSH 就能连进去!

Cloud-Init 自动化模板克隆与注水流程:

18.2 Terraform 自动化部署 🚜

如果你会写代码,可以用 Terraform 管理 PVE 资源。Provider 生态会变化,建议优先选择维护活跃、与你当前 PVE 版本兼容的 Provider。 你只需要写一段 HCL 语言的代码:

resource "proxmox_vm_qemu" "k8s_worker" { count = 3 # 一次性创建 3 台 name = "k8s-node-${count.index + 1}" target_node = "pve-node1" clone = "ubuntu-template" # 克隆我们刚才做的模板 cores = 4 memory = 8192 os_type = "cloud-init" ipconfig0 = "ip=192.168.1.10${count.index + 1}/24,gw=192.168.1.1" sshkeys = <<EOF ssh-rsa AAAAB3NzaC1...你的公钥... EOF}运行 terraform apply 后,Terraform 会通过 PVE API 批量创建并初始化虚拟机。建议在流水线中加入 plan 审核、状态锁和失败回滚策略。

Terraform IaC (基础设施即代码) 自动化闭环时序图:

🎓 全文总结

至此,《Proxmox VE (PVE) 实战指南》六卷内容已完成。

从第一卷的底层硬件与内核机制,到 ZFS 与 Ceph 的存储哲学;从 OVS 与 SDN 的网络重塑,到 KVM 与 LXC 的性能压榨;从硬核的 PCIe IOMMU 直通博弈,直到本卷的高可用集群与 PBS 容灾自动化。

本文覆盖了从单机到集群的关键实践路径,并尽量标注了前置条件与风险边界。

PVE 是一套工程化平台:它由 Debian Linux、KVM、LXC、ZFS、Ceph、Corosync 等组件协同构成。

愿这份指南能作为你的实施基线与排障清单。建议持续做版本校对、压测与故障演练。Happy Hacking!

(全文终)

文章分享

如果这篇文章对你有帮助,欢迎分享给更多人!